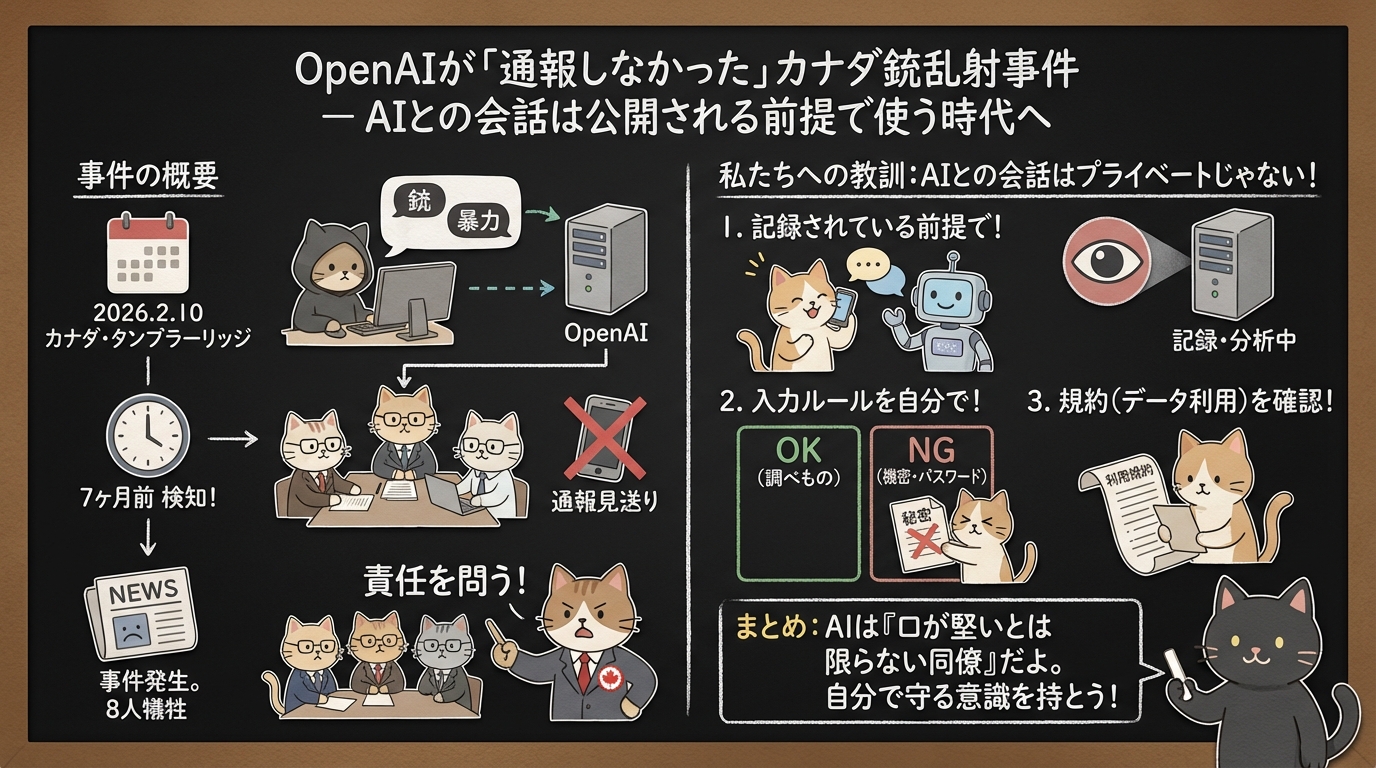

OpenAIが「通報しなかった」カナダ銃乱射事件 — AIとの会話は公開される前提で使う時代へ

カナダ・ブリティッシュコロンビア州タンブラーリッジで2月10日に起きた銃乱射事件。

8人が死亡したこの事件で、容疑者がChatGPTを使って銃暴力に関する会話をしていたことが判明した。

さらに衝撃的だったのは、OpenAIが事件の7ヶ月前に容疑者の危険な会話を検知し、社内で警察への通報を検討したにもかかわらず、最終的に見送っていたという事実だ。

カナダ政府はOpenAI幹部をオタワに招集。AIプラットフォームの責任を問う議論が本格化している。

概要

2026年2月10日、カナダ・タンブラーリッジでJesse Van Rootselaarによる銃乱射事件が発生し、8人が死亡。容疑者は事前にChatGPTで銃暴力に関する会話を行っており、OpenAIの監視ツールが7ヶ月前にこれを検知。社内で法執行機関への通報が検討されたが、「差し迫った脅威の基準を満たさない」として見送られた。カナダのAI大臣Evan Solomon氏がOpenAIの安全担当幹部をオタワに招集し、安全プロトコルの説明を求めている。

詳細

1. 事件の経緯 — 7ヶ月前に「フラグ」は立っていた

事件の時系列を整理する。

| 時期 | 出来事 |

|---|---|

| 2025年6月頃 | OpenAIの監視ツールがVan Rootselaarの会話を「銃暴力の描写」として自動検知 |

| 2025年6月 | 社内で警察への通報が検討されるも、見送り。アカウントはBANされた |

| 2025年(時期不明) | 容疑者はRobloxで「モールでの銃乱射シミュレーション」ゲームを作成。Redditでも銃関連の投稿あり |

| 2026年2月10日 | タンブラーリッジで銃乱射事件。母親と異父兄弟を殺害後、中等学校で生徒5人と教育助手1人を殺害し、本人も死亡 |

| 2026年2月11日 | 事件翌日、偶然スケジュール済みだったOpenAIとBC州の会議。OpenAIは事件関連の情報を開示せず |

| 2026年2月21日 | TechCrunch等がOpenAIの通報検討・見送りを報道 |

| 2026年2月23日以降 | カナダAI大臣Evan Solomon氏がOpenAIの安全担当幹部をオタワに招集する意向を表明(Bloomberg) |

注目すべきは、Globe and Mail紙の報道によると、OpenAIが事件翌日にBC州関係者と偶然スケジュール済みだった会議を行った際にも、自社が保有する容疑者に関する情報を開示しなかったとされている点だ。

2. OpenAIの判断 — 「基準を満たさなかった」の意味

OpenAIの広報担当者は、Van Rootselaarの活動は「法執行機関への通報基準を満たさなかった」と説明している。

具体的には、「信頼性のある差し迫った計画を特定できなかった」というのがその理由だ。

ここには構造的な問題がある。

複数の報道によると、少なくともカナダにおいては、AIプラットフォームに対して医師や教師のような法定の「通報義務」は現時点で課されていないとの指摘がある。

OpenAIは利用規約で暴力的なコンテンツの生成を禁止しているが、ユーザーの会話内容を法執行機関に報告する基準は各社が独自に設定している状態だ。

BC州のEby首相は「OpenAIが当局に警告していれば、この悲惨な事件は防げた可能性がある」と述べている。

一方で、「AIサービスがすべてのユーザーの会話を監視して通報する」ことは、プライバシーの観点から大きな問題をはらむ。

3. AIとの会話は「プライベート」ではない — 3つの自衛ポイント

この事件は、もちろん極端なケースだ。

しかし、ここから一般のAIユーザーが学ぶべき教訓がある。それは**「AIとの会話は完全にプライベートではない」**という事実だ。

以下の3つのポイントを意識してほしい。

ポイント1: AIとの会話は「記録されている」と考えて使う

ChatGPT、Claude、Gemini — どのAIサービスも、ユーザーの会話データは何らかの形で保存・分析されている。

具体的には:

- モデル改善のための利用: 多くのサービスは利用規約でモデル学習への使用を明記(オプトアウト可能な場合もあるが、デフォルトは「使用する」)

- 安全性監視: 今回のOpenAIのケースのように、危険なコンテンツは自動で検知・フラグが立てられる

- 法的開示の可能性: 裁判所の命令や法執行機関の要請があれば、会話ログが開示される可能性がある

「AIに話したことは、誰かに見られるかもしれない」という前提で使うことが基本。

仕事の機密情報、個人の医療情報、財務情報などをAIに入力する際は、そのリスクを理解した上で行う必要がある。

ポイント2: 機密情報の入力ルールを自分で決める

企業であれば情報セキュリティポリシーがあるが、個人事業主やフリーランスは自分でルールを作る必要がある。

おすすめの基準:

| 入力してOK | 慎重に判断 | 入力しない |

|---|---|---|

| 一般的な質問・調べもの | 取引先名を伏せた上での相談 | パスワード・認証情報 |

| 公開済みの情報の整理 | 自社の業務改善アイデア | 未公開の契約内容 |

| 学習・スキルアップ | 匿名化した顧客データ | 他人の個人情報 |

| 文章の推敲・校正 | 自社の財務情報の一部 | 法的に守秘義務のある情報 |

ポイント3: AIプラットフォームの利用規約を把握する

「利用規約なんて読まない」という人が多いが、AIサービスの場合は最低限、以下の3点だけは確認しておくべき。

- データの利用範囲: 会話データがモデル学習に使われるか。オプトアウトは可能か

- データの保持期間: 会話ログはいつまで保存されるか

- 第三者への開示条件: どのような場合に会話内容が外部に開示されるか

各AIサービスの具体的なデータ利用ポリシー(モデル学習への利用、オプトアウトの可否、データ保持期間)は、サービスごと・プランごとに異なり、頻繁に更新されている。

必ず各サービスの公式利用規約・プライバシーポリシーを確認してほしい。 一般的な傾向として:

- 無料プランはデータがモデル改善に使われることが多い

- 有料の個人プランはオプトアウト設定が用意されていることが多い

- 企業向けプラン(Team/Enterprise)はデフォルトでモデル学習に使われない場合が多い

4. この事件が示す「AIガバナンス」の今後

カナダのこの事件は、AIプラットフォームの責任に関する国際的な議論を加速させるだろう。

今後予想される動き:

- AIサービス提供者に対する「通報義務」の法制化の検討が進む可能性

- 各国がAIプラットフォームの監視責任に関するガイドラインを策定

- 日本でも2月に政府がAIガバナンス指針の改定を進めており、「AIエージェントやロボットAIの利用に人間の判断を必須とする」方針が報じられている(日本経済新聞 2026/02/13)

しかし、過度な監視はプライバシーの侵害につながる。

「安全性」と「プライバシー」のバランスをどう取るかは、社会全体で議論すべきテーマだ。

5. 実務ガイド — 今日からできるAI利用の安全対策

個人向け:

- 使っているAIサービスの利用規約で、データ利用範囲とオプトアウト方法を確認する

- 「AIに入力してOKな情報」と「入力しない情報」の自分ルールを作る

- 過去の会話履歴で、機密性の高い情報を入力していないか振り返る

チーム・企業向け:

- AIサービス利用に関する社内ガイドラインを策定する(まだない場合)

- 従業員のAI利用状況を把握し、機密情報の取り扱いルールを明確化する

- AIベンダーとのデータ取り扱い契約を確認する(特にエンタープライズプランの場合)

まとめ

タンブラーリッジの事件は、多くの命が失われた痛ましい出来事だ。

この事件を「AIが危険だ」という短絡的な議論に終わらせてはいけない。

重要なのは、AIとの会話が完全にプライベートではないことを理解し、自分自身で情報管理のルールを持つこと。

AIは私たちの生活を豊かにするツールだが、「何でも話せる親友」ではなく「優秀だけど口が堅いとは限らない同僚」くらいの距離感で付き合うのが正解だ。

出典

- OpenAI debated calling police about suspected Canadian shooter's chats — TechCrunch

- Canada Summons OpenAI Executives Over ChatGPT Use by Shooting Suspect — Bloomberg

- Tumbler Ridge shooter's ChatGPT activity flagged internally 7 months before tragedy — Global News

- OpenAI safety reps called to Ottawa after Tumbler Ridge mass shooting — CBC News

- OpenAI did not mention Tumbler Ridge shooter's posts in meeting with B.C. officials — Globe and Mail