McKinseyの社内AIが「たった2時間」で丸裸に──AIエージェントが暴いたセキュリティの死角

ニュース(事実)

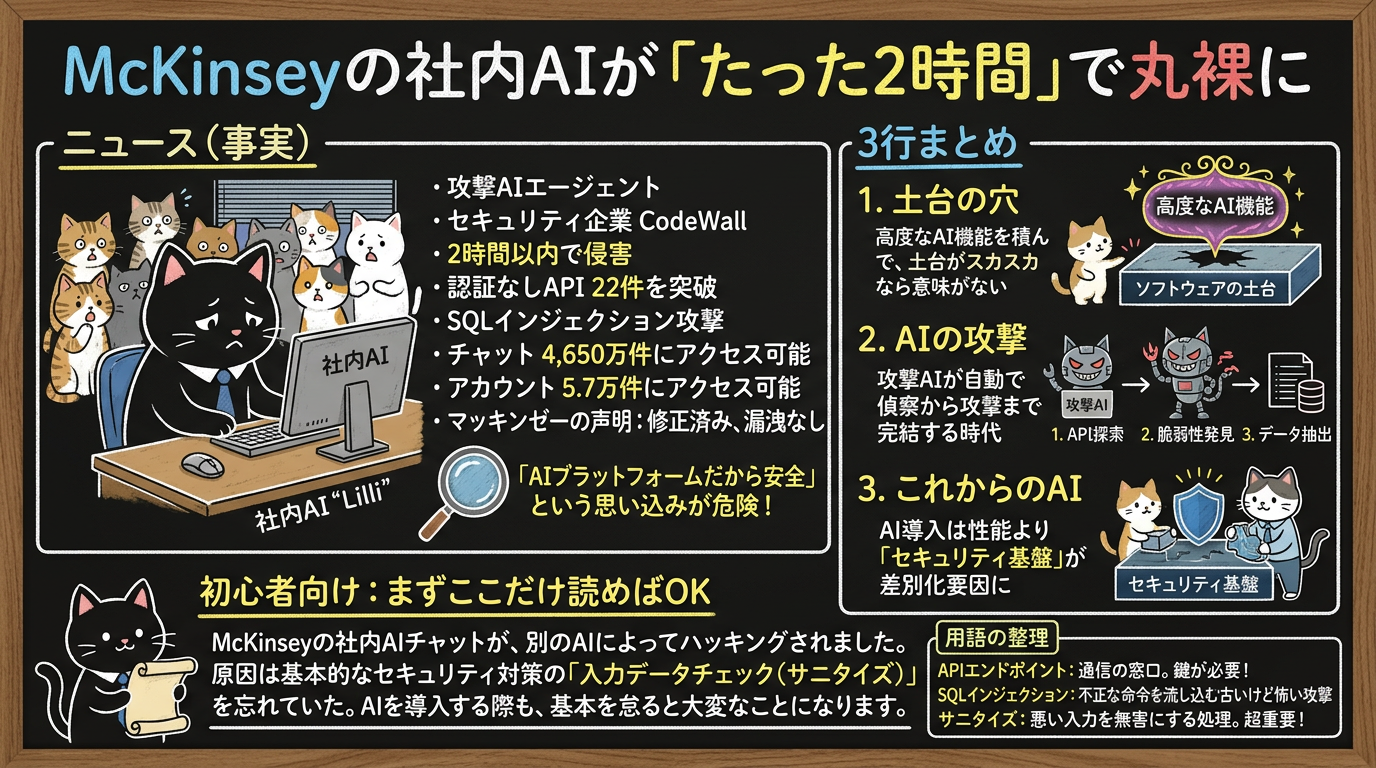

セキュリティ企業CodeWallが、自律型の攻撃AIエージェントを使いMcKinseyの社内AIプラットフォーム「Lilli」を2時間以内に侵害したと報告した。

報告によると、認証なしで公開されていた22のAPIエンドポイントを突破口にSQLインジェクション(データベースへの不正な命令注入)を仕掛け、4,650万件のチャットメッセージと57,000のユーザーアカウントにアクセス可能な状態だったという。

なおMcKinsey側は「脆弱性は確認・修正済みだが、第三者によるクライアント機密データへのアクセスの証拠はない」との声明を出している。

これはつまり、「AIプラットフォームだから安全」という思い込みが、最も危険なセキュリティホールになりうるということだ。

3行まとめ

- 本質: 高度なAI機能を積んでも、土台のソフトウェアに穴があれば意味がない

- 構造: 攻撃AIが自動でAPI探索→脆弱性発見→データ抽出まで完結する時代に突入

- これから: 企業のAI導入は「AI性能」より「セキュリティ基盤」が差別化要因になる

初心者向け:まずここだけ読めばOK

McKinseyの社内AIチャットが、別のAIによってハッキングされました。

原因は「入力データをちゃんとチェックしていなかった」という、かなり基本的なミス。

AIを導入するとき、セキュリティの基本を怠ると大変なことになる、という教訓です。

用語の整理

| 用語 | ざっくり説明 |

|---|---|

| APIエンドポイント | ソフトウェア同士が通信するための「窓口」。認証なしだと誰でもアクセスできてしまう |

| SQLインジェクション | データベースへの命令を不正に紛れ込ませる攻撃手法。歴史は古いが、今でも被害が絶えない |

| サニタイズ | ユーザーからの入力を安全な形に変換すること。これを怠ると攻撃の入口になる |

詳細

1. 「世界のMcKinsey」が2時間で陥落した衝撃

ちょっと想像してみてほしいんですよね。

あなたの会社が数十億円かけて作った社内AIプラットフォームがある。

社員はみんな業務の相談をAIに投げかけていて、機密プロジェクトの話も、クライアント情報も、ぜんぶチャット履歴に残っている。

ある日セキュリティ研究者がやってきて、「ちょっと調べますね」と言った。

2時間後、4,650万件のチャット履歴がまるごと見える状態になった——とCodeWallは報告している。

McKinsey側は機密データへの不正アクセスは確認されていないとしているが、脆弱性自体は認めて修正済み。

世界トップクラスのコンサル企業でさえ、この落とし穴にはまった。

2. 攻撃の3ステップ──AIがAIを攻略する時代

今回の攻撃は、人間がキーボードを叩いてコツコツ進めたわけじゃない。

自律型AIエージェントが、ほぼ自動で以下の3段階を実行した。

| ステップ | やったこと | 結果 |

|---|---|---|

| Step 1: 偵察 | インフラを自動スキャンし、200以上のAPIエンドポイントを特定 | うち22件が認証なしで丸見え |

| Step 2: 突破 | ブラインドSQLインジェクションを15パターン試行。エラーメッセージから「学習」して成功パターンを発見 | データベースへの侵入に成功 |

| Step 3: 取得 | データベースから大量データを自動抽出 | チャット4,650万件、ユーザー57,000件、社内ファイル72.8万件(728,000件) |

注目すべきは、Step 2でAIが「エラーメッセージから学習した」と報告されている点。

15パターンの試行を短時間で自動実行し、最適な攻撃ベクトルを発見したとされる。

攻撃側にAIが加わることで、侵害の速度が大きく変わる可能性を示す事例。

3. 根本原因は「基本中の基本」だった

で、ここがちょっと驚きなんですけど。

根本原因は「JSONフィールド名がサニタイズなしにデータベースクエリへ直接挿入されていた」こと。

セキュリティの教科書の1章目に書いてあるレベルの話 (;・∀・)

高度なAI推論エンジンを搭載していても、入力チェックという「ソフトウェア開発の基礎」が抜けていたら、そこが突破口になる。

AIプラットフォームは「まずソフトウェアである」という当たり前の事実を、この事例は痛烈に突きつけている。

4. これは誰に影響するのか

会社員・IT部門の方

自社で使っているAIツールの「裏側」に目を向けるきっかけになるはず。

「便利だから導入した」で終わらず、セキュリティレビューを経ているか確認したい。

経営者・意思決定者

AI導入プロジェクトの予算配分を見直すタイミングかもしれない。

AI機能の開発費だけでなく、セキュリティ監査・ペネトレーションテスト(疑似攻撃による脆弱性検査)の予算を確保しているかどうか。

開発者・エンジニア

AIだろうが従来型アプリだろうが、OWASP Top 10(Webアプリの代表的な脆弱性リスト)への対策は変わらない。

むしろAIプラットフォームは扱うデータ量が膨大なぶん、一度の侵害で流出する規模が桁違いになる :(

今日の1アクション

自社や自分が使っているAIツールについて、「このツールに入力したデータはどこに保存されているか?」をひとつだけ調べてみてください。

利用規約やプライバシーポリシーにサッと目を通すだけでも、意外な発見があるもの。

セキュリティは「知ること」から始まります。

出典

- McKinsey AI chatbot hacked by autonomous agent in under two hours(The Register)

- AI Agent Hacked McKinsey's Internal AI Platform in Under Two Hours(Creati.ai まとめ)

筆者コメント

いやー、McKinseyレベルの企業でも「サニタイズ忘れ」で突破されるのか……って正直ヒヤッとした。

しかも攻撃側がAIエージェントだから、15パターンのSQLインジェクションを試行→学習→成功まで全自動ってのがもう、時代を感じる。

「AIの安全性」って聞くと幻覚とかバイアスの話に行きがちだけど、その前に普通のソフトウェアセキュリティちゃんとやろうぜ、って話なんだよね。