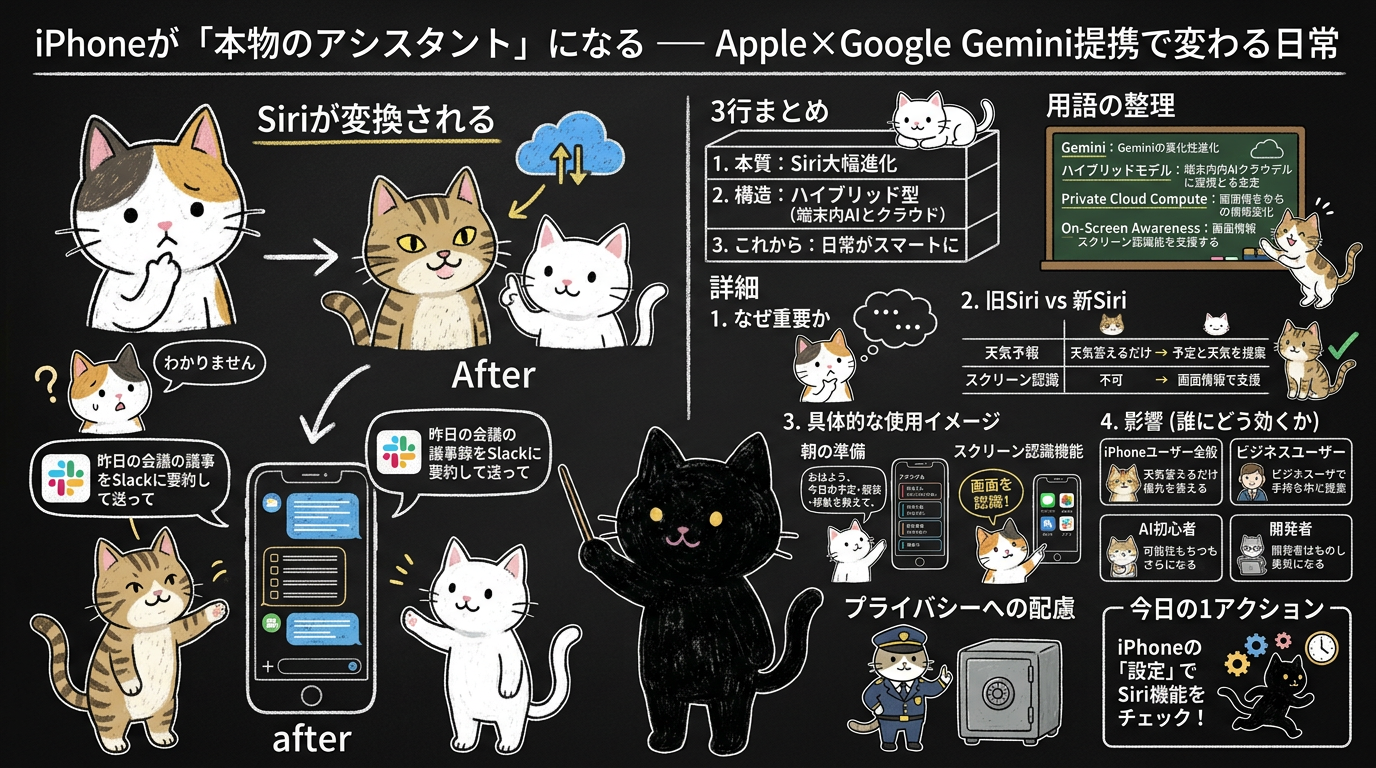

iPhoneが「本物のアシスタント」になる — Apple×Google Gemini提携で変わる日常

ニュース(事実)

2026年1月12日、AppleとGoogleがGeminiモデルを活用した複数年契約を正式に締結したとReutersとTechCrunchが報道しました。これにより、GoogleのAI「Gemini」が刷新版Siriを支援することが確認されています。リリース時期についてはBloomberg/9to5MacがiOS 26.4を内部目標として報じており、画面上の情報を認識して文脈を理解する「On-Screen Awareness(画面認識)」機能の搭載もBloombergが伝えています(いずれも内部目標・予測段階)。

3行まとめ

- 本質: AppleがGoogleのAI「Gemini」を採用し、Siriが大幅に進化する可能性が報じられている

- 構造: 簡単なタスクは端末内で、複雑な問いはGoogleのGeminiが処理するハイブリッド型が想定される

- これから: iPhoneユーザーの日常が、よりスマートでシームレスなものに変わる可能性がある

初心者向け:まずここだけ読めばOK

Siriが劇的に賢くなる可能性があります。「昨日の会議の議事録をSlackに要約して送って」「明日の天気に合わせた服装を教えて」のような複雑なリクエストが通るようになる見込みです。2026年春頃の登場が報じられています。

用語の整理

| 用語 | 意味 |

|---|---|

| Gemini(ジェミニ) | Googleが開発した大規模言語モデル。OpenAIのGPTシリーズと競合する最強クラスのAI |

| ハイブリッドモデル | 端末内のAIとクラウドのAIを状況に応じて使い分ける方式 |

| Private Cloud Compute | Appleが独自に開発したプライベートクラウド処理基盤 |

| On-Screen Awareness | 画面上の情報を認識してAIが文脈を理解する機能(Bloombergが報じた機能) |

詳細

1. なぜ重要か(背景・意味)

「あ、Siriがまた言うこと聞かない...」という経験はありませんか?

Appleはこれまで、AI機能は「自社で完結させる」方針を貫いてきました。しかし、自社のFoundation Model(AFM)開発での遅延や品質課題が指摘される中、外部モデル活用の検討が報じられるようになりました。

この提携は、AppleとGoogleという競合同士が手を組む異例の展開です。複数社の報道では契約成立とされていますが、実装範囲・提供時期の最終確定はApple公式発表待ちです。機能の詳細と時期については今後の発表が待たれます。

2. 旧Siri vs 新Siri — 想定されるユースケース比較

以下は報じられた機能を元にした、想定される体験の変化です(未確認の具体機能は予測として記載)。

| シーン | 旧Siri | 新Siri(Gemini統合後の想定) |

|---|---|---|

| 天気予報 | 「明日の天気は?」→ 天気を答えるだけ | 「明日の予定があるから、雨なら傘を持って行くように教えて」→ 予定と天気を組み合わせて提案(想定) |

| メール検索 | 「田中さんからのメール」→ 一覧を表示 | 「昨日の田中さんとの会議に関するメールを要約して」→ 内容を理解して要約(想定) |

| スクリーン認識 | 不可 | 画面上の情報を認識して文脈に応じた支援(On-Screen Awarenessとして報告あり) |

3. 具体的な使用イメージ

朝の準備(想定シナリオ)

「おはよう。今日の予定と、それに合わせた服装、移動ルートを教えて」

旧Siri: 「今日の天気は曇りです」で終わり

新Siri(想定): カレンダー・天気・地図を組み合わせた総合的な提案

スクリーン認識機能(報告済み)

Bloombergの報道では、Siriが画面上に表示されているボタンやコンテンツを識別し、「今見ている画面で何をしたいか」を推測して支援できるようになるとされています。

4. 影響(誰にどう効くか)

| セグメント | 変化 |

|---|---|

| iPhoneユーザー全般 | 音声操作が「便利な補助」から「主要なインターフェース」になる可能性 |

| ビジネスユーザー | メールの要約、会議の議事録作成、タスク管理の効率化が期待される |

| AI初心者 | ChatGPTなどのツールを使わなくても、日常の中で自然にAIの恩恵を受けられる |

| 開発者 | 新しいAPIを通じてアプリとSiriの連携が強化される可能性がある |

プライバシーへの配慮:

プライバシーへの配慮については、複数の報道でGoogleへのデータ共有を最小化する方向性が示唆されています。実装の詳細(処理方式やデータ範囲)は今後の正式発表を待つ必要があります。

今日の1アクション

iPhoneの「設定」→「Siriと検索」で、今使えるSiri機能を一度チェックしてみましょう。

新Siri登場時に、自分がどう活用したいかイメージしておくと、アップデート後すぐに体験を始められます。

出典

- Bloomberg: Apple's AI Wearables Push; What to Expect From March 4 Low-End MacBook Launch (2026年2月22日)

- Reuters/Investing.com: Google and Apple enter into multiyear AI deal for Gemini models (2026年1月12日)

- TechCrunch: Google's Gemini to power Apple's AI features like Siri (2026年1月12日)

- Bloomberg: Apple Plans to Use 1.2 Trillion-Parameter Google Gemini Model to Power New Siri (2025年11月5日)

- 9to5Mac: Apple now targeting iOS 26.4 for long-delayed Siri AI upgrade (2025年6月12日)

筆者コメント

「ついにSiriがまともに動く日が来る」と、iPhoneユーザーの悲願が叶う形ですね。でも一方で、Appleが自社開発にこだわっていた姿勢が大きく変わった—この選択が良い方向に転ぶのか、今後の動向が気になります。個人的には、スクリーン認識機能に期待大。指でタップする回数が減りそうです。