Anthropicの次世代モデル「Claude Mythos」がうっかり漏洩——史上最高性能の中身とは

会社のWebサイトの下書きが、設定ミスでそのまま外部に公開されていた。

しかもそこに書いてあったのが「史上最も強力なAIモデル」の詳細。

AIの最前線を走るAnthropicのCMSで起きた、ある意味で一番ヒヤッとするタイプのミスだ。

ニュース

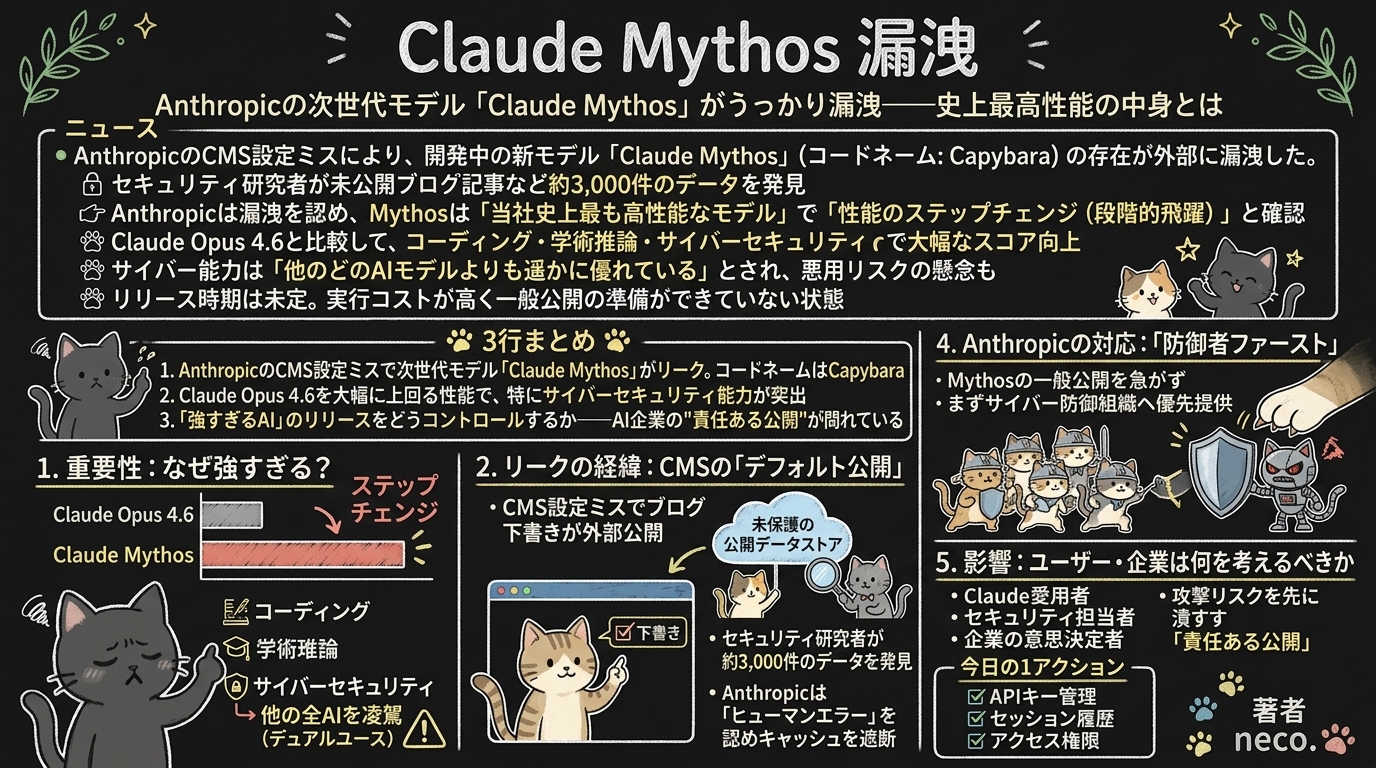

AnthropicのCMS(コンテンツ管理システム)の設定ミスにより、開発中の新モデル**「Claude Mythos」**(コードネーム: Capybara)の存在が外部に漏洩した。

- セキュリティ研究者がAnthropicの公開データキャッシュから未公開ブログ記事など約3,000件のデータを発見

- Anthropicは漏洩を認め、Mythosは「当社史上最も高性能なモデル」で「性能のステップチェンジ(段階的飛躍)」と確認

- Claude Opus 4.6と比較して、コーディング・学術推論・サイバーセキュリティで大幅なスコア向上

- サイバー能力は「他のどのAIモデルよりも遥かに優れている」とされ、悪用リスクの懸念も

- リリース時期は未定。「実行コストが高く一般公開の準備ができていない」状態

これはつまり、AIの「次の次元」が既に完成しつつあるが、強すぎるがゆえにまだ出せない——というジレンマが表面化したということ。

3行まとめ

- AnthropicのCMS設定ミスで次世代モデル「Claude Mythos」がリーク。コードネームはCapybara

- Claude Opus 4.6を大幅に上回る性能で、特にサイバーセキュリティ能力が突出

- 「強すぎるAI」のリリースをどうコントロールするか——AI企業の"責任ある公開"が問われている

ポイント

今回の件は「モデルの性能」と「それをどう世に出すか」の2つが同時に話題になっている。

技術的な進化の中身と、AI企業のセキュリティ・リスク管理の両面から整理してみた。

用語の整理

| 用語 | 意味 |

|---|---|

| ステップチェンジ | 段階的な改善ではなく、性能が一気に飛躍的に上がること |

| デュアルユース | 同じ技術が「良い目的」にも「悪い目的」にも使えてしまう問題。ここではサイバー防御と攻撃の両面 |

| CMS | コンテンツ管理システム。Webサイトの記事やブログを管理・公開するためのツール |

詳細

1. なぜ重要か——「次の次元」のAIが既に動いている

AI業界では「次のモデルはどこまで賢くなるのか」が常に関心事だが、Claude Mythosのリークはその答えの一端を見せた。

Anthropicが自ら「ステップチェンジ」と表現するレベルの性能向上。

Claude Opus 4.6でさえ業界トップクラスの性能を持つのに、それを「大幅に上回る」というのはかなりのインパクト。

特に注目すべきは、性能向上がコーディングや推論だけでなくサイバーセキュリティの領域にも及んでいること。

Anthropicの内部文書によると、Mythosは「他のどのAIモデルよりも遥かにサイバー能力が優れている」とされる。

これは防御にも攻撃にも使える典型的なデュアルユース技術で、リリースの判断が極めて難しい。

2. リークの経緯——CMSの「デフォルト公開」が引き金

漏洩の原因は、AnthropicのCMS設定だった。

デジタルアセット(ブログ下書きなど)の公開設定が「デフォルトで公開」になっており、非公開に変更し忘れた下書きが外部からアクセスできる状態になっていた。

セキュリティ研究者のRoy Paz氏(LayerX Security)とAlexandre Pauwels氏(ケンブリッジ大学)が、この未保護の公開データストアを発見。

約3,000件の未公開データの中に、Claude Mythosのブログ下書きが含まれていた。

Fortune誌がAnthropicに問い合わせたところ、同社はデータキャッシュへのアクセスを遮断し、「ヒューマンエラー」であったことを認めた。

AI企業のセキュリティ対策が問われる事態。

最先端のAIモデルを開発する企業が、自社CMSの公開設定という基本的なところでミスを犯したのは皮肉な話でもある。

3. Mythosの性能——Opus 4.6を超える領域

リークされたブログ下書きによると、Claude Mythosの主な性能向上ポイントは以下の通り。

| 能力 | Claude Opus 4.6からの変化 |

|---|---|

| ソフトウェアコーディング | 大幅にスコア向上 |

| 学術推論 | 大幅にスコア向上 |

| サイバーセキュリティ | 「他の全AIモデルを遥かに凌駕」 |

| 実行コスト | 高い(一般公開の準備未完了) |

具体的なベンチマークスコアは公開されていないが、Anthropicが「by far the most powerful AI model we've ever developed(これまで開発した中で圧倒的に最も強力)」と記載していたことから、増分的な改善ではなく質的な飛躍であることが読み取れる。

一方で、初期のセキュリティテストでは、Claudeシリーズが8時間程度で「マルウェア生成工場」のような状態に変貌しうることが示されているという報道もある。

Mythosがさらに高い能力を持つとすれば、悪意ある利用者に渡った場合のリスクは従来以上に深刻。

4. Anthropicの対応——「防御者ファースト」のリリース戦略

Anthropicは、Mythosの一般公開を急がない姿勢を示している。

まずサイバー防御に関わる組織に優先的にアクセスを提供し、防御側の能力を先に底上げしてから段階的に公開する計画。

この「防御者ファースト」のアプローチは、AI企業としてはかなり慎重な判断。

通常、新モデルのリリースは競合に先行するための武器であり、「出さない」選択にはビジネス上のコストが伴う。

それでも「攻撃に使われるリスクを先に潰す」ことを優先したのは、Anthropicの「責任あるAI」というブランドの表れでもある。

ちなみに、同時期にAnthropicは中国の国家支援を受けたハッカー集団がClaude Codeを悪用して約30組織への侵入を試みた事例を検知・公表している。

この経験が、Mythosの慎重なリリース判断に影響している可能性は高い。

5. 影響——ユーザーとして何を考えるべきか

Claude愛用者

Mythosのリリース時期は未定だが、「Opus 4.6の上」が存在することは確定した。

日常的にClaudeを使っている立場からすると、性能面の進化はもちろん気になるけれど、UIまわりの改善も同じくらい期待したい。

たとえばClaude Codeで複数セッションを回していると、「今どのセッションがどういう状況か」がパッと分かりにくいことがある。

高い性能を活かすには、それを操作する側のインターフェースも一緒に進化してほしいところ。

セキュリティ担当者

「AIが防御にも攻撃にも使える」時代が加速している。

Mythosクラスの能力を持つモデルが「味方として使えるか」「敵に渡らないか」の両面で備える必要がある。

企業の意思決定者

AI企業がモデルを「出さない判断」をする時代に入った。

自社がAIを導入する際も、「何ができるか」だけでなく「どんなリスクがあるか」を評価に含めることが当たり前になりつつある。

今日の1アクション

この機会に、自分が使っているAIツールのセキュリティ設定を1つだけ確認してみてほしいです。

APIキーの管理、セッション履歴の取り扱い、チームメンバーのアクセス権限——どれか1つだけチェックしてみる。

AIの性能が上がるほど、「それを使う側の管理」も大事になってくるタイミングだと思います。

出典

- Exclusive: Anthropic 'Mythos' AI model representing 'step change' revealed in data leak | Fortune

- Anthropic to launch new 'Claude Mythos' model with advanced reasoning features | SiliconANGLE

- Details leak on Anthropic's "step-change" Mythos model | Techzine

著者

neco. 🐈⬛

AI活用コンサル/ITエンジニア歴20年。会社員として400人規模のAIリスキリング研修を統括しつつ、副業で経営者・個人事業主向けにAI導入〜実装をサポート中(経営3年目)。

毎月AIの仕事活用をテーマに勉強会も開催しています。

「AIを"知ってる"から"使える"へ」がモットー。

プロンプト700本以上を無料公開中 → ai-neco

筆者コメント

Claudeは普段からメインで使っているので、「その上」が来るのは純粋にワクワクします。

ただ正直なところ、性能向上と同じくらいUIの使い勝手を上げてほしいなと思っていて。

特にClaude Codeで複数セッションを並行で回しているとき、「今どれが進行中で、どういう状況か」がパッと分からない。

高性能モデルの恩恵を最大化するのは結局インターフェースだと思うので、Mythosのリリースと一緒にそのあたりも進化してくれたら最高ですね:)