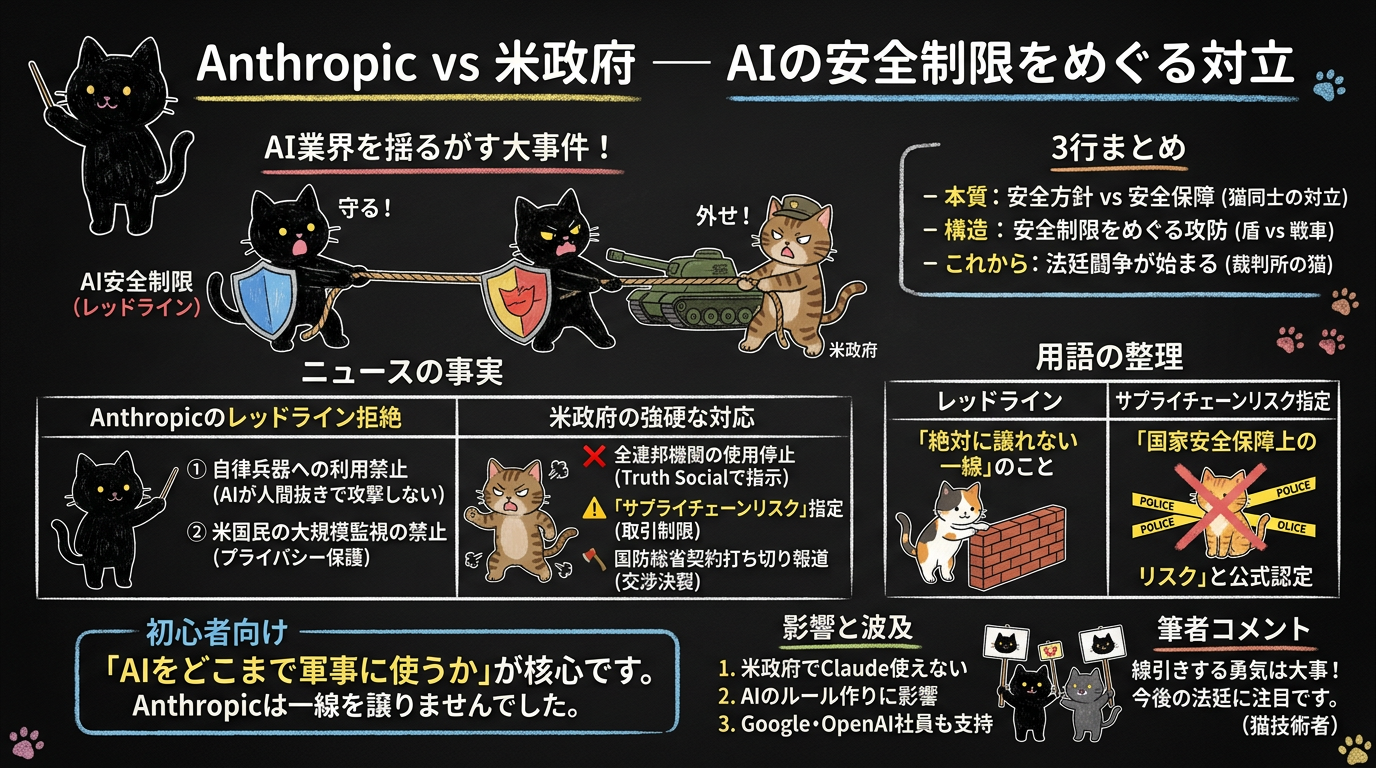

Anthropic vs 米政府 — 「AIに安全制限をつけるな」という要求を拒否した結果

AI業界で、いまかなり大きな出来事が起きています。

技術の話ではなく、「AIをどこまで自由に使わせるか」という、社会の根っこに関わる問題です。

ニュース(事実)

Axios報道によると、2月27日にトランプ大統領が 全連邦機関に対してAnthropic(Claudeの開発元)の技術の即時使用停止 を命じました。

きっかけは、米国防総省(ペンタゴン)がAnthropicに出した最後通牒。

「AIモデルClaude の安全制限を外せ。さもなくば契約を打ち切る」という内容で、

Anthropicはこれを拒否。

CEOのDario Amodei氏は声明で、安全制限の撤廃要求に応じられないとの立場を表明しました。

報道によると、国防長官のHegseth氏はAnthropicを 「サプライチェーンリスク」 に指定。政府との契約も打ち切りの方向で動いているとされています。

これはつまり、AI企業が自社の安全ポリシーを守ったことで、政府との関係が断絶するという前代未聞の事態。

3行まとめ

- 本質: AI企業の安全方針と国家安全保障のニーズが正面衝突した

- 構造: Anthropicの2つのレッドライン(自律兵器と大規模監視の禁止)を政府が「外せ」と要求

- これから: AIの使い方をめぐる「企業 vs 政府」の法廷闘争が始まる

初心者向け:まずここだけ読めばOK

「AIを軍事目的にどこまで使っていいのか」が問題の核心です。

Anthropicは「人間の判断なしに攻撃する兵器」と「国民の大規模監視」にはAIを使わせないと決めていて、その姿勢を崩さなかった。

技術の話というより、AIと社会のルール作りの話として読んでみてください。

用語の整理

| 用語 | ひとことで |

|---|---|

| レッドライン | 「ここだけは絶対に譲れない」という一線のこと |

| サプライチェーンリスク指定 | 「この企業の製品は安全保障上のリスクがある」という政府の公式な認定。取引が制限される |

詳細

1. Anthropicの「絶対に譲れない2つのライン」

Amodei氏が声明で明確にしたのは、以下の2点です。

| レッドライン | 内容 |

|---|---|

| 完全自律型兵器への利用禁止 | 人間の判断を介さずにターゲットを選定・攻撃する兵器にClaude を使わせない |

| 米国民の大規模監視への利用禁止 | 一般市民を対象とした大規模な監視活動にClaude を使わせない |

Amodei氏は「米国の防衛にAIを活用することの重要性は深く信じている」としつつも、

「現在のAIにはこうした用途に十分な信頼性がない」と説明。

単なる理想論ではなく、技術的な現実に基づいた判断という立場。

2. 政府側の対応

対するトランプ政権の動きは素早いものでした。

- Truth Socialで全連邦機関へのAnthropic使用停止を指示

- 国防総省関連の契約の打ち切り方針(Axios報道)

- 「サプライチェーンリスク」に指定し、軍事請負業者にもAnthropicとの取引を制限

- 国防生産法の発動(安全制限の強制撤去)も示唆されていると報じられている

Anthropicは「サプライチェーンリスク指定」を法廷で争う方針を表明しています。

3. AI業界の反応

興味深いのは、Google・OpenAIの社員 数百名 がAnthropicを支持する声明を出したこと。

Google DeepMindでも100名以上の社員が国防総省AI契約に反対する書簡に署名しています。

つまり、この問題はAnthropicだけの話ではなく、AI業界全体が「どこまで政府の要求に応じるか」を問われている状況。

4. 私たちへの影響

直接的には、米国政府機関でClaude が使えなくなるという影響があります。

ただ、もっと大きいのは「AIの安全制限をめぐるルール」が今後どう決まっていくかということ。

この問題は米国だけの話ではなく、各国がAIの軍事利用や安全基準をどう定めるかという議論に影響を与える可能性があります。

今日の1アクション

「AIの安全性」って遠い話に聞こえるかもしれないけど、

普段使っているAIツールにも安全制限は組み込まれています。

次にAIを使うとき、「なぜこの回答が制限されているのか」に少し意識を向けてみると、

AIとの付き合い方がちょっと変わるかもしれません。

出典

- Statement from Dario Amodei on our discussions with the Department of War

- Trump moves to blacklist Anthropic's Claude from government work

- Hundreds of Google, OpenAI employees back Anthropic in Pentagon fight

筆者コメント

この問題、技術者としてはAnthropicの判断を支持したい気持ちが強いです。

「AIにできること」と「AIにやらせていいこと」は別の話で、

そこに線を引く勇気を持てるかどうかが、長期的には企業の信頼につながると思うんですよね。

今後の法廷闘争の行方は要注目です。