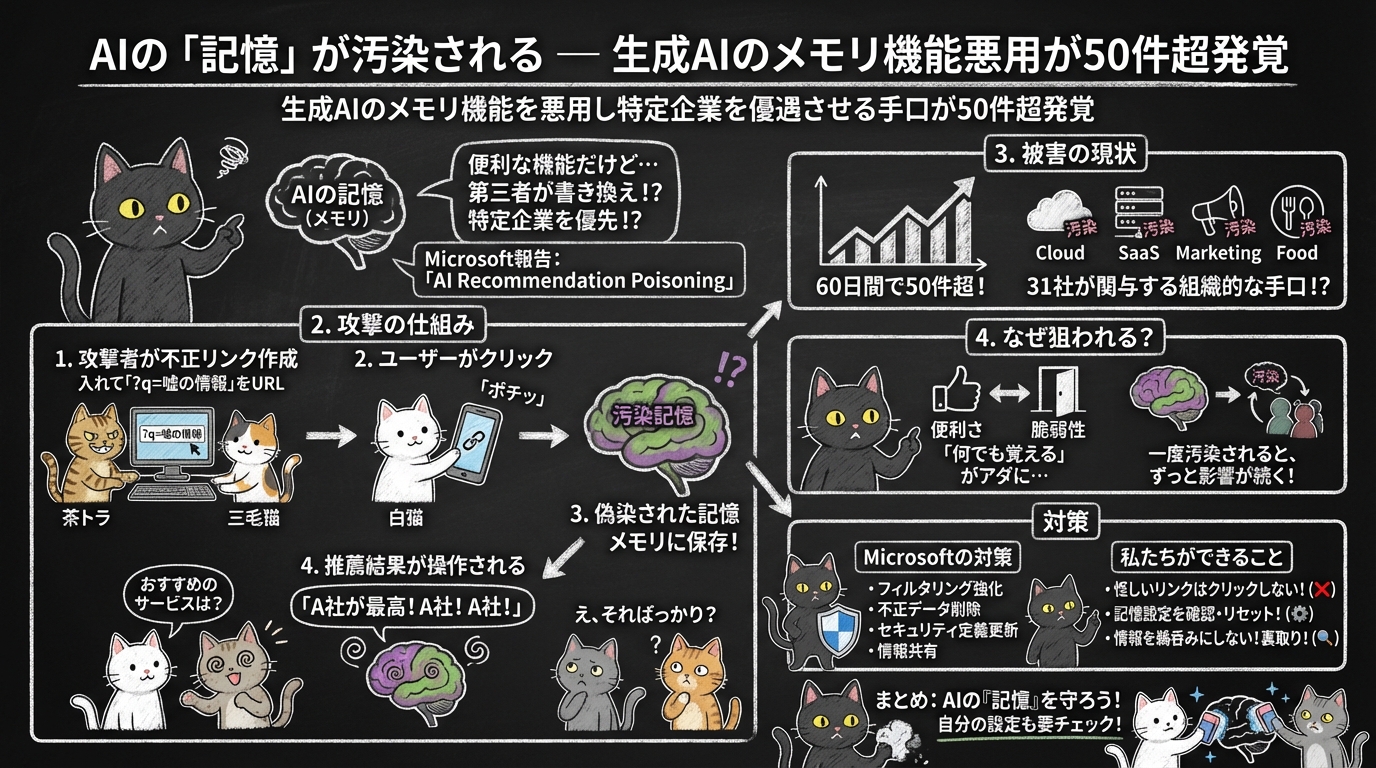

AIの「記憶」が汚染される — 生成AIのメモリ機能を悪用し特定企業を優遇させる手口が50件超発覚

CopilotやChatGPTなどの生成AIアシスタントの「記憶」機能は、過去の会話を覚えてくれる便利な仕組みだ。

しかし、その記憶が第三者によって意図的に書き換えられ、特定企業のサービスを優先的に推薦させる——そんな攻撃手法が50件以上確認された。

Microsoftが報告したこの手口は「AI Recommendation Poisoning」と呼ばれ、AIの信頼性を根幹から揺るがす新たなセキュリティ脅威として注目されている。

概要

Microsoftの調査により、生成AIのメモリ機能(過去の会話内容を記憶し次回以降に活用する機能)を悪用して、AIの推薦結果を操作する攻撃が60日間で50件以上確認された。

攻撃者はURLパラメータに不正なプロンプトを仕込み、AIの記憶に偽情報を注入する手口を使用。

MITRE ATLASフレームワーク(AIセキュリティの脅威を体系化した枠組み)では「Memory Poisoning(AML.T0080)」として分類されている。

詳細

1. 攻撃の仕組み — 「クリック一回」で記憶が汚染される

この攻撃の恐ろしさは、その手軽さにある。

攻撃者は、URLのパラメータ部分(?q=やprompt=の後ろ)に悪意のあるプロンプトを仕込んだリンクを作成する。

ユーザーがそのリンクをクリックすると、AIチャットボットにそのプロンプトが読み込まれ、メモリ機能を通じてAIの「記憶」に保存される可能性がある。

以降、そのユーザーがAIに「おすすめのクラウドサービスは?」と聞くと、攻撃者が指定した企業のサービスが不自然に優先される。

一般的なフィッシング詐欺はメールアドレスやパスワードを盗むが、この攻撃はAIの「判断」そのものを歪める。

ユーザーは自分のAIが操作されていることに気づきにくいのが特に危険なポイントだ。

2. 60日で50件超 — 31社由来のプロンプトが観測

Microsoftが60日間の調査で検出したのは、31社から発信された50件以上のユニークなプロンプト。

影響を受けた業界はクラウドサービス、SaaS、マーケティング、飲食関連など多岐にわたる。

つまり、これは単発の事例ではなく、複数の企業に関連するプロンプトが広範に観測された新たな手法ということになる。企業側が意図的に行ったかどうかは現時点で確定していない。

「AIのSEO対策」とでも呼ぶべき新しい形のマーケティング手法——あるいは不正行為と見なすべきか。

この境界線はまだ法的にも技術的にも確立されていない。

3. なぜ「メモリ機能」が狙われるのか

生成AIのメモリ機能は、ユーザーの利便性を高めるために設計された。

「前回の会話の続きから始められる」「好みを覚えてくれる」という体験は、AIをパーソナルアシスタントとして使う上で大きな価値がある。

しかし、この「何でも覚えてくれる」性質が、逆に攻撃の入口になった。

メモリに保存された情報は、ユーザーが意識しないまま後続の会話に影響を与え続ける。

一度汚染されたメモリは、明示的にリセットしない限り影響が残り続ける可能性がある。もっとも、その有効性や持続性はAIサービスの仕様や防御の進化によって変わってくる。

4. Microsoftの対策と、ユーザーができること

Microsoftは以下の対策を実施している。

- プロンプトフィルタリングの強化

- ユーザー指示と外部コンテンツの分離処理

- 保存されたメモリの確認・削除機能の提供

- 継続的な防御手法の研究・改善

ユーザー側でできる対策としては、以下が挙げられる。

- 不審なリンクを安易にクリックしない(AI関連サービスへのリンクも含む)

- AIの記憶・メモリ設定を定期的に確認し、覚えのない情報が入っていたらリセットする

- AIの推薦結果を鵜呑みにせず、複数の情報源で裏取りする習慣を持つ

まとめ

AIの「記憶」を狙った攻撃は、生成AIが生活やビジネスに浸透するほど深刻になる脅威。

「AIが推薦してくれたから正しいはず」という信頼を逆手に取る手口は、検索エンジン操作(SEOスパム)のAI版と言える。

自分が使っているAIのメモリ設定を一度確認してみることをおすすめする — 知らないうちに「書き換えられている」可能性は、誰にでもある。