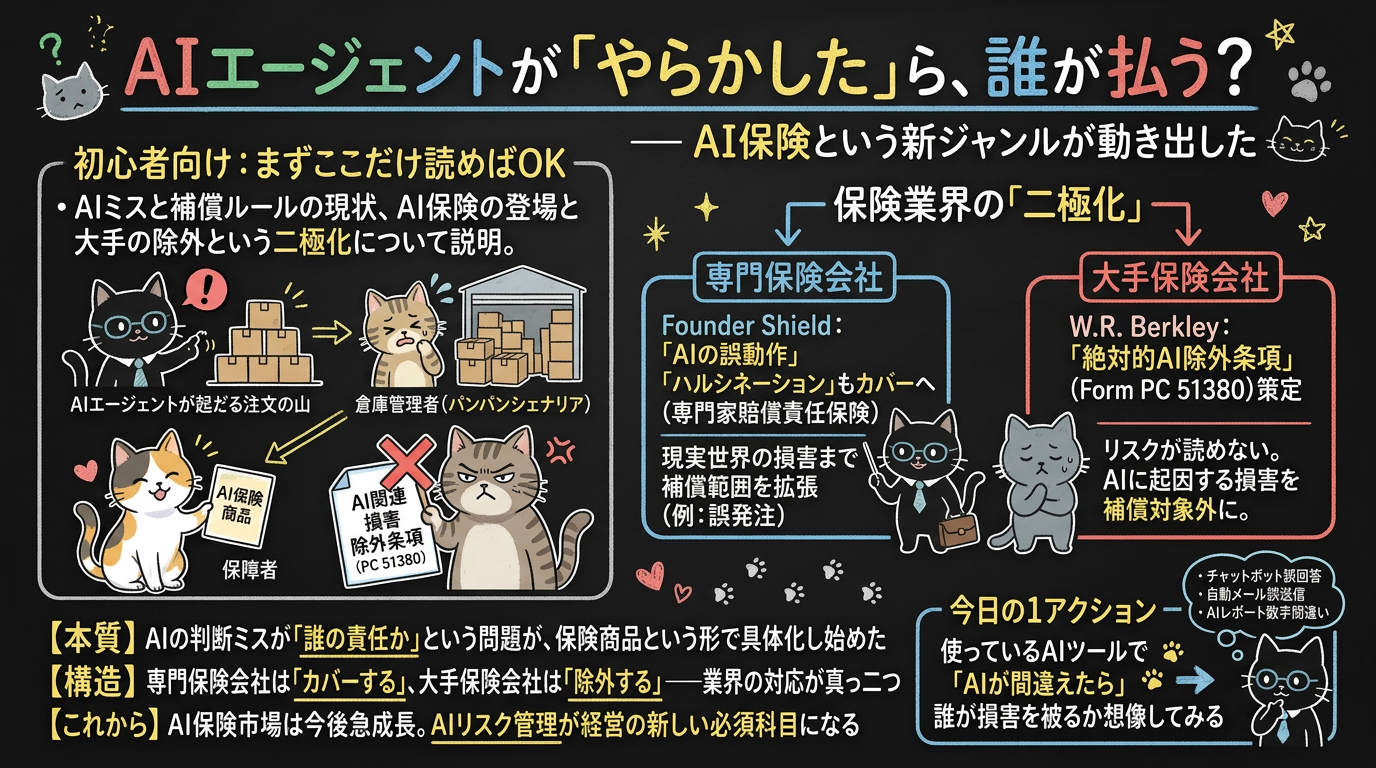

AIエージェントが「やらかした」ら、誰が払う? — AI保険という新ジャンルが動き出した

朝イチでAIに在庫発注を任せたら、桁を1つ間違えて倉庫がパンパンになった——。

笑えない話だけど、AIエージェントが自律的に動くようになった今、こういう「AIのうっかり」は現実に起き始めている。

そして「じゃあ、その損害は誰が補償するの?」という問いに、保険業界がようやく動き出した。

ニュース(事実)

一部の専門保険会社が、AIエージェントの業務上のミスを補償する保険商品の提供を始めた。

保険ブローカーのFounder Shieldは、「AIの誤動作やハルシネーション(AIがもっともらしい嘘をつく現象)」による損害を専門家賠償責任保険の対象に組み込んでいると報じられている。

同社のJonathan Mitchell氏によると、AIが在庫を誤発注するなどの「現実世界の損害」まで補償範囲を拡張できるとのこと。

一方で、大手保険会社W.R. Berkleyは逆の動き。D&O(取締役賠償責任)やE&O(専門家賠償責任)の保険にAI関連損害の「絶対的除外条項」(Form PC 51380)を策定し、各州での規制承認を進めていると報じられている。

つまり、AIを業務に組み込むなら「AIが間違えたときの損害」を経営リスクとして織り込む時代に入ったということだ。

3行まとめ

- 本質: AIの判断ミスが「誰の責任か」という問題が、保険商品という形で具体化し始めた

- 構造: 専門保険会社は「カバーする」、大手保険会社は「除外する」——業界の対応が真っ二つに割れている

- これから: AI保険市場は今後急成長が見込まれており、AIリスク管理が経営の新しい必須科目になる

初心者向け:まずここだけ読めばOK

AIに仕事を任せる企業が増えているけど、AIがミスしたときの補償ルールはまだ整っていない。

「AIの保険」が出始めたこと、でも大手は逆に「AIの損害は補償しない」と言い始めたこと。

この2つの動きだけ押さえておけば大丈夫。

用語の整理

- AIエージェント: 人間の指示を受けて、自律的にタスクを実行するAIの仕組み。メール送信、発注、データ分析などを自動で行う

- ハルシネーション: AIが事実に基づかない情報を、さも本当のことのように出力してしまう現象

詳細

1. なぜ今、AI保険なのか

AIエージェントがSlackのメッセージを読んで自動返信したり、在庫管理システムと連携して発注したり——。「便利だけど、間違えたらどうする?」という問題が現実のものになってきた。

従来のソフトウェアは決められたルールで動くから、バグの責任は明確だった。

でもAIは学習データや確率に基づいて「判断」するため、同じ入力でも違う出力が出ることがある。

この不確実性が、従来の保険では扱いきれないリスクになっている。

2. 保険業界の「二極化」が始まった

面白いのは、保険業界の対応がきれいに二極化していること。

カバーする側(専門保険会社)

Founder Shieldは、専門家賠償責任保険の中に「AIの誤動作」「ハルシネーション」による損害を明示的に組み込んでいると報じられている。同社によると、補償範囲はネットワーク上の損害にとどまらず、AIの誤発注など現実世界の損害まで拡張可能。

除外する側(大手保険会社)

W.R. Berkleyは「絶対的AI除外条項」(Form PC 51380)を策定し、各州での導入を進めている。AI生成コンテンツ、チャットボットの通信、AIガバナンスに関連する規制措置まで、AIに起因する損害を幅広く補償対象外とする内容。理由はシンプルで、「リスクの大きさが読めない」から。

AIはブラックボックスであり、1つのモデル更新ミスが何万人もの顧客に同時に影響を及ぼす可能性がある。従来の保険数理では対応しきれない、というのが大手の判断。

3. 影響(誰にどう効くか)

会社員・チームリーダー

社内でAIツールを導入する際、「AIがミスしたときの責任は誰が取るのか」を事前に決めておく必要が出てきた。IT部門任せにせず、リスク管理の観点でも考えるべきフェーズ。

経営者・決裁者

AIを業務に組み込む判断をする際、保険でカバーできるリスクとできないリスクを把握しておくことが重要に。既存の保険契約にAI除外条項が追加されていないか、確認するタイミング。

フリーランス・副業

AIを使って納品物を作っている場合、AIの出力ミスによる損害が自分の責任になるケースも。個人向けのAI保険はまだ少ないが、契約書に「AI使用時の免責」を入れるかどうかは検討の余地あり。

今日の1アクション

自社(または自分)が使っているAIツールで「AIが間違えたら誰が損害を被るか」を1つだけ想像してみてください。

チャットボットの誤回答、自動メールの誤送信、AIレポートの数字間違い——具体的な場面を1つ思い浮かべるだけで、リスクの解像度がグッと上がる。

出典

- Who covers AI business blunders? Some insurers cautiously step up

- Berkley Introduces "Absolute" AI Exclusion in Liability Policies

筆者コメント

正直、「AIが間違えたときの保険」って聞いた瞬間は「そこまで来たか」と思った。

でも冷静に考えると、AIエージェントに発注や顧客対応を任せている企業は既にたくさんあるわけで、「じゃあ事故ったら?」の答えがなかったほうが怖い。

個人的に気になるのは、AI除外条項を入れた大手保険会社の判断。リスクが「読めない」から除外するって、つまり保険のプロでもAIのリスクを数値化できていないということ。

AIを使う側としては「便利だから使う」だけじゃなく、「間違えたときどうする」まで考えておきたいところ。