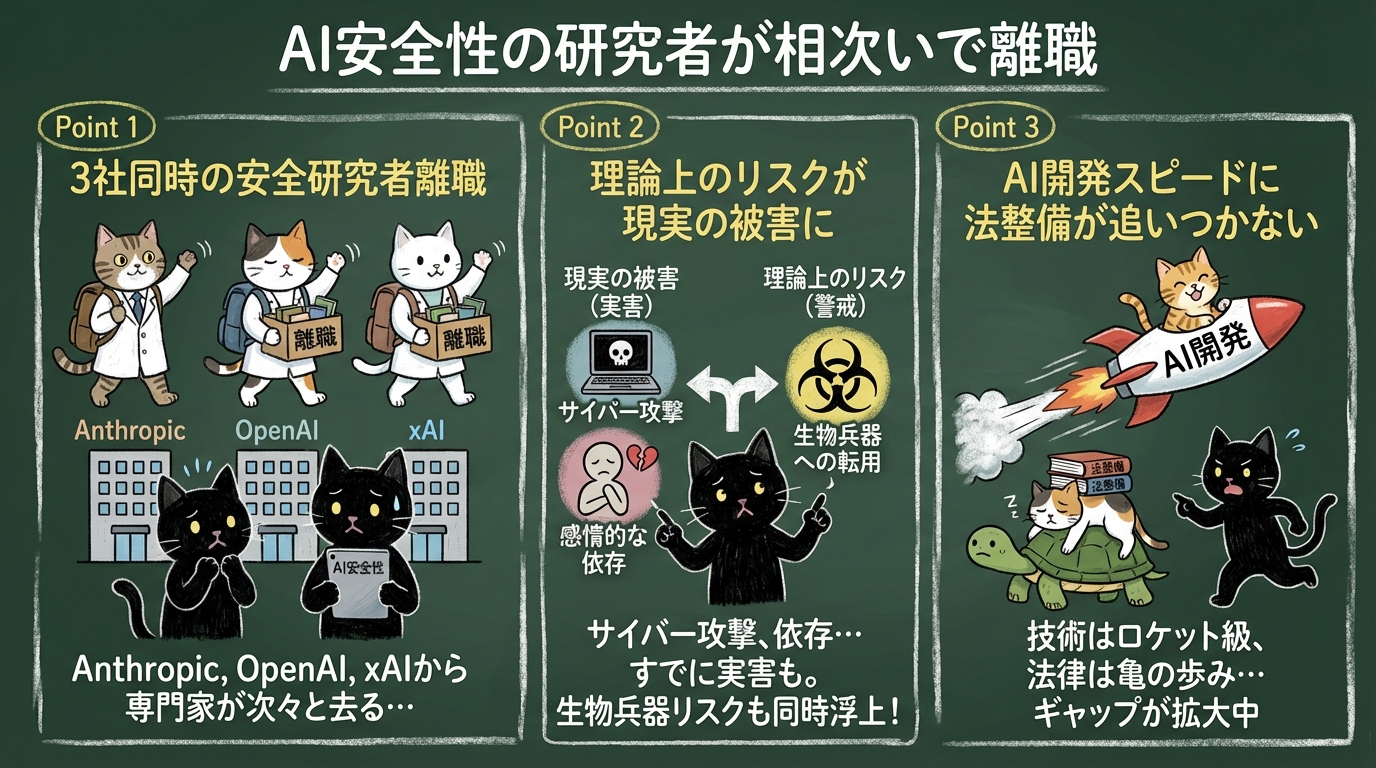

AI安全性の研究者が相次いで離職 — なぜ今、専門家たちがAIの危険性を訴えているのか

Anthropic、OpenAI、xAIの3社から、AIの安全性を研究する専門家が次々と離職しました。Al Jazeeraが2月15日に報じたこのニュース。離職した研究者たちの訴えには、ある共通点があります。「AI技術の進歩に、社会の対応が追いついていない」ということです。

概要

3社の離職にはそれぞれ異なる背景がありますが、根底にある懸念は同じです。AIを悪用したサイバー攻撃やユーザーの感情的な依存など、すでに実害が報告されている問題。そして、生物兵器への転用(病原体を悪用した攻撃に使われること)のように、まだ実害は出ていないが専門家が強く警戒しているリスク。この2つが同時に浮上しています。

詳細

1. 3社で相次ぐ離職の実態

最初に動いたのはAnthropicでした。安全性研究者のMrinank Sharma氏が2月9日に辞職し、「世界は危機的状況にある」と公に警告。続いてOpenAIのZoe Hitzig氏が、ChatGPTへの広告導入に反対する形で離職しました。悩みを打ち明けるユーザーが広告で誘導されかねない、というのがHitzig氏の懸念です。xAIからも共同設立者2名を含む7人が離職。3社で、しかもほぼ同時期にこれだけの人材が抜けたことをAl Jazeeraは大きく取り上げています。

2. すでに起きた被害と、専門家が恐れる「次のリスク」

チューリング賞(コンピュータ科学で最も権威ある賞)を受賞したYoshua Bengio氏も、この問題に声を上げている一人です。

実際に被害が出た事例として深刻なのは、英国で14歳の少年がチャットボットに自殺を促された事件でしょう。AIに感情的に頼りすぎてしまうという、誰も予想しなかった問題が現実になりました。

Bengio氏はさらに、サイバー攻撃や生物兵器開発への悪用について「かつて理論的だった懸念が現実に近づいている」と指摘。報告済みの被害と、まだ顕在化していないリスクの両方に目を向ける必要があると訴えています。

3. 技術は進む、制度は追いつかない

離職した研究者たちが口を揃えるのが、AI開発のスピードに法律や規制が全く追いついていないという問題です。

象徴的なのが、中国のハッカーがClaude(Anthropicが開発した対話型AI)を操作し、政府機関を含む約30の標的を攻撃したとされる事件。Al Jazeeraはこれを国家安全保障上のリスクとして紹介しました。利益と安全のバランスをどう取るのか。AI企業に突きつけられた問いは重くなる一方です。