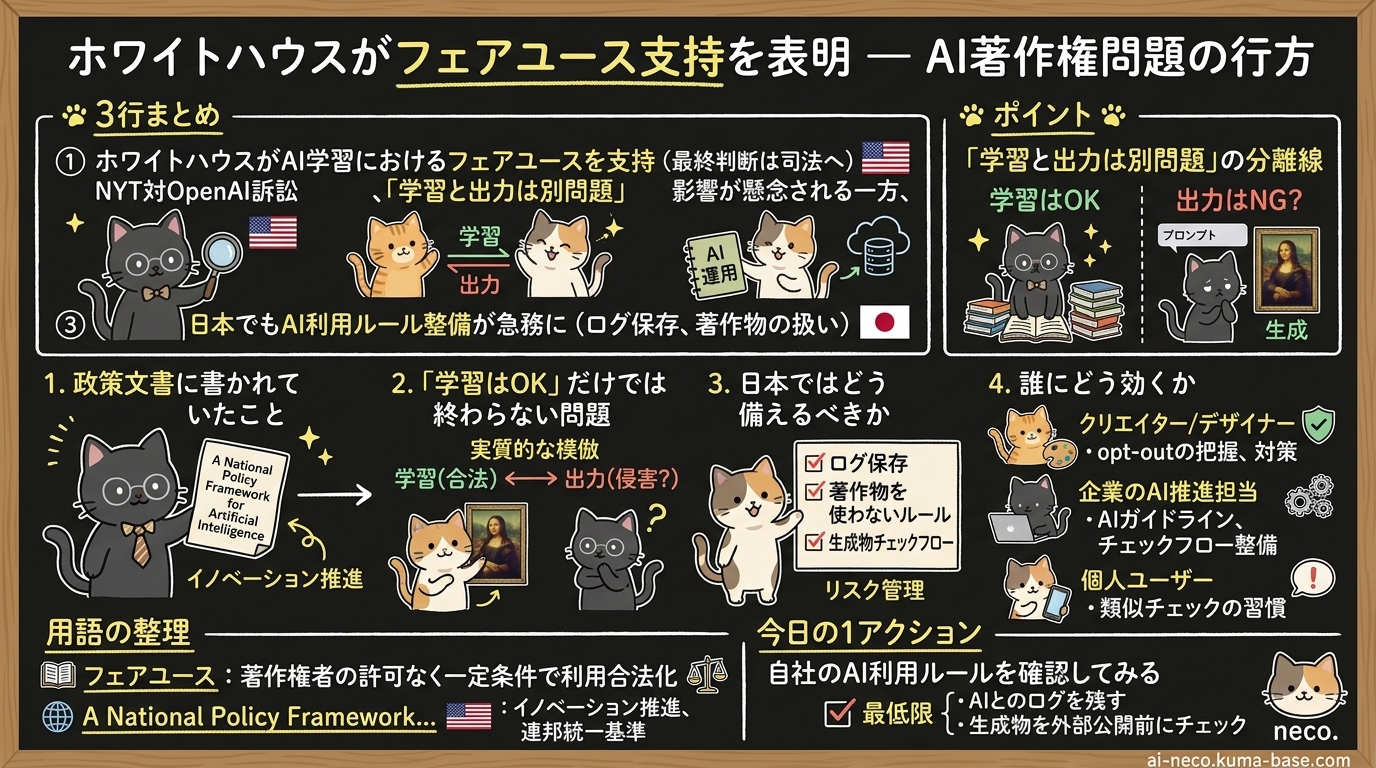

ホワイトハウスがフェアユース支持を表明 — AI著作権問題の行方

AIに画像を作ってもらったとき、「これ、誰かの作品に似てない?大丈夫かな」と一瞬考えたことはありませんか。

企業でAIを使うとき、「著作権的に問題ないのか」は避けて通れないテーマになっています。

3月20日にホワイトハウスが発表したAI政策フレームワークで、AI学習データの「フェアユース」を支持する立場が明らかになり、3月23日にメディアで改めて大きく報じられました。

AI企業にとっては追い風、クリエイターにとっては逆風——この対立は2026年のAI業界最大の論点の一つです。

ニュース

ホワイトハウスが3月20日に発表した「A National Policy Framework for Artificial Intelligence: Legislative Recommendations」で、AIモデルの学習データに著作物を使用することについて、政権は学習利用を非侵害とみる立場を示しつつ、フェアユース(公正な利用)の最終判断は司法に委ねる姿勢を併記しています。このスタンスが3月23日のメディア報道で改めて注目を集めました。

- 政策文書では、AIによる著作物の学習利用についてフェアユースを支持する政権見解を記載(法的な確定ではなく、最終判断は裁判所に委ねられる)

- AI企業にとっては政策的な追い風となる見通し

- クリエイター・メディア業界からは強い反発の声

つまり、「AIが学ぶのはOK、でも出力が侵害したら?」という境界線の議論がこれから本格化する。

3行まとめ

- ホワイトハウスがAI学習におけるフェアユースを支持する政権見解を発表。ただし法的確定ではなく、最終的な判断は裁判所に委ねられる

- NYT対OpenAI訴訟やアーティスト訴訟への影響が懸念される一方、「学習と出力は別問題」という論点が浮上

- 日本でもAI利用時のルール整備(ログ保存、著作物の扱い)が急務に

ポイント

フェアユースの議論は「AIが学習すること自体」と「AIが出力したもの」を分けて考える必要があります。

学習は合法でも、出力が既存の著作物にそっくりだった場合は別の問題。

この"分離線"をどこに引くかが、今後の焦点になります。

用語の整理

- フェアユース: 著作権者の許可なく著作物を利用しても、一定の条件(教育目的、批評、報道など)を満たせば合法とする米国著作権法の原則。日本の著作権法にも類似の制度はあるが、範囲が異なる

- A National Policy Framework for Artificial Intelligence: Legislative Recommendations: トランプ政権が3月20日に発表したAI政策の包括的な枠組み。7つの柱で構成され、州法に優越する連邦統一基準を目指している

詳細

1. 政策文書に書かれていたこと

3月20日に発表された「National Policy Framework for Artificial Intelligence」は、AI学習における著作物の利用についてフェアユースを支持する政権見解を明記しています。

3月23日のメディア報道で著作権の観点から改めて注目が集まり、クリエイター側からの反発が表面化しました。

フレームワーク自体が「イノベーション推進」を柱の一つに掲げているため、学習データの利用を制限すれば開発が停滞する——という考え方が政策に反映されているとみられます。

一方で、具体的な法制化にあたっては議会での議論が必要で、クリエイター側の声がどこまで反映されるかはまだ不透明。

2. 「学習はOK」だけでは終わらない問題

フェアユースの支持が意味するのは、「AIモデルが著作物を学習データとして読み込むこと自体は合法」という立場。

しかし、これだけでは解決しない問題が山ほどあります。

たとえば、AIが生成した画像が特定のアーティストのスタイルにそっくりだった場合。

学習は合法でも、出力が「実質的な模倣」にあたるなら著作権侵害になりうる。

現在進行中のニューヨーク・タイムズ対OpenAI訴訟では、ChatGPTがNYTの記事をほぼそのまま出力したケースが争点になっています。

音楽業界でも、AIが特定のアーティストの「声」や「スタイル」を再現する問題が深刻化していて、「学習は合法でも出力が侵害なら?」という問いは簡単には答えが出そうにありません。

3. 日本ではどう備えるべきか

海外の事例、特にシリコンバレーでの著作権裁判は参考になるところが多いです。

日本でも、AIを業務に導入するときに著作権のルールを整備する動きが出てきています。

具体的には、AIとのやり取りのログを残すこと、著作物を明示的に使わない運用ルールを作ること、生成物のチェックフローを設けることなど。

「あとから問題になったとき、どう説明できるか」を事前に考えておくのが大事ですね。

AI研修の現場で著作権の話になると、やはり「で、結局何がOKで何がNGなの?」という質問が必ず出ます。

現時点では明確な線引きがないのが正直なところですが、だからこそ「自分たちのルール」を先に作っておくことが、リスク管理として有効だと思います。

4. 誰にどう効くか

クリエイター・デザイナー: 自分の作品がAIの学習に使われることへの対策を検討するタイミング。opt-out(学習拒否)の仕組みがあるサービスを把握しておく

企業のAI推進担当: AI利用ガイドラインに著作権の項目を追加。生成物のチェックフロー、ログ保存のルールを整備する

個人でAIを使っている方: AI生成コンテンツをそのまま公開する前に、「既存の著作物に類似していないか」の簡易チェックを習慣にする

今日の1アクション

自社(または自分)のAI利用で、著作権に関するルールがあるか確認してみるのがおすすめです。

まだないなら、最低限「AIとのやり取りのログを残す」「生成物を外部公開する前にチェックする」の2点だけでも決めておくと安心感が違います。

出典

- A National Policy Framework for Artificial Intelligence: Legislative Recommendations(PDF)(White House 一次文書)

- President Donald J. Trump Unveils National AI Legislative Framework(White House 記事)

- White House Backs AI Fair Use in New Regulation Proposal

著者

neco. 🐈⬛

AI活用コンサル/ITエンジニア歴20年。会社員として400人規模のAIリスキリング研修を統括しつつ、副業で経営者・個人事業主向けにAI導入〜実装をサポート中(経営3年目)。

毎月AIの仕事活用をテーマに勉強会も開催しています。

「AIを"知ってる"から"使える"へ」がモットー。

プロンプト700本以上を無料公開中 → ai-neco