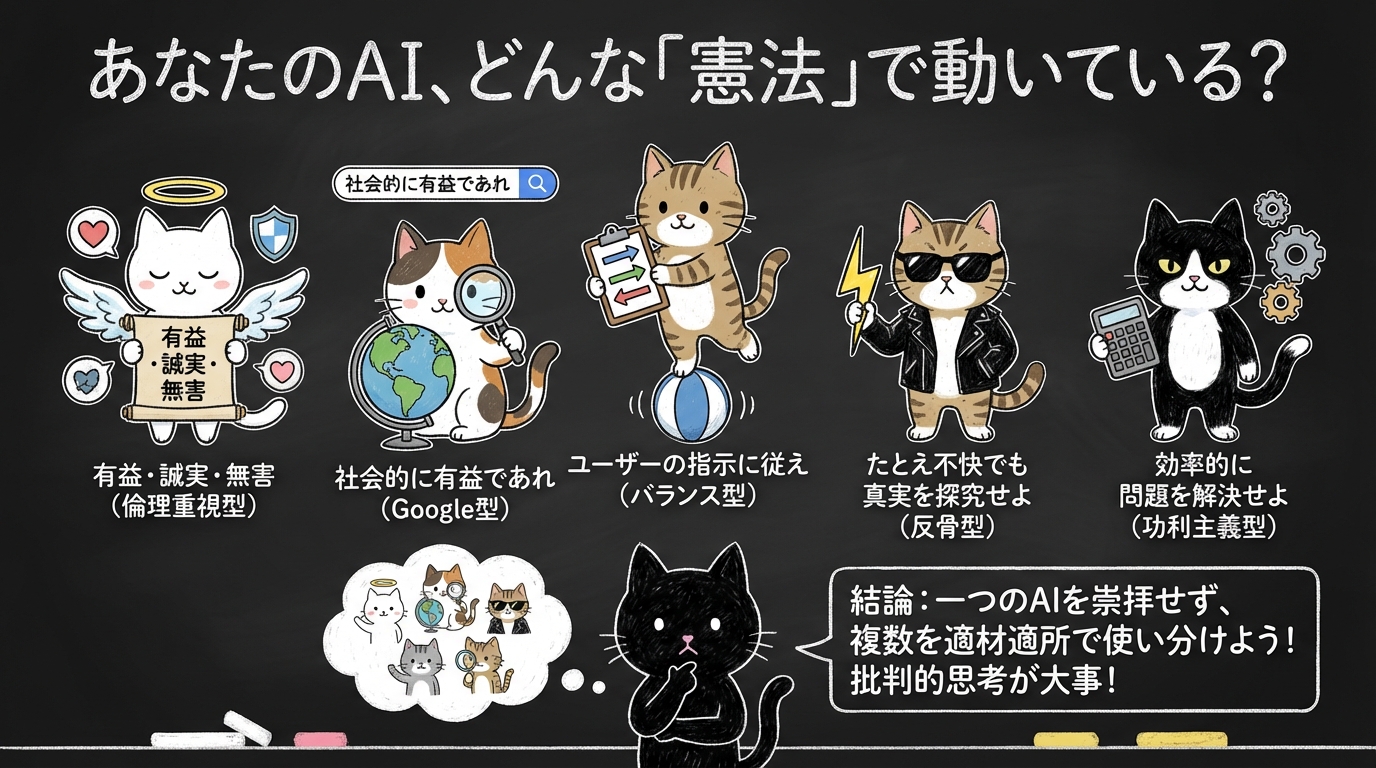

あなたのAI、どんな「憲法」で動いている? ── 5大AIの設計思想を解剖する

AIが返す答えをそのまま受け入れていませんか?

実はその回答、開発企業が定めた「憲法」によってフィルタリングされた結果かもしれません。

シリコンバレーで活動するエンジニアが、5大AIの設計方針を原文から読み解いた動画が公開されています。

概要

この動画で解説されるのは、AIの出力品質を左右する最大の変数が「アライメント(価値観の調整)」にあるという視点です。

Claude、Gemini、ChatGPT、Grok、DeepSeekの5つのAIはそれぞれ異なる「憲法」を持ち、同じ質問でも返ってくる答えのトーンが大きく違います。

どのAIを選ぶかは、自分の思考をどの企業の価値観に預けるかという選択でもある――動画はそう問いかけています。

5大AIの設計思想まとめ

| AI | 開発元 | 核となる方針 | タイプ | 強み | 注意点 |

|---|---|---|---|---|---|

| Claude | Anthropic | 有益・誠実・無害 | 倫理重視型 | 長期的な信頼構築に最適 | 倫理的にグレーな相談は拒否される |

| Gemini | 社会的に有益であれ | 秩序重視型 | 事実に基づく網羅的な回答 | 革新的・過激な提案は抑えられやすい | |

| ChatGPT | OpenAI | ユーザーの指示に従え(安全範囲内) | バランス型 | 幅広い用途に対応 | 出力が最大公約数的になりやすい |

| Grok | xAI | たとえ不快でも真実を探究せよ | 反骨型 | タブーに切り込む議論に強い | ブレーキが弱くリスクも伴う |

| DeepSeek | DeepSeek | 効率的に問題を解決せよ | 功利主義型 | 指示に忠実で実装向き | データセキュリティの懸念あり |

詳細

1. 安全重視派 ── Claude・Gemini・ChatGPT

動画によると、Claudeの行動指針「Constitutional AI」には「最も有益で誠実で無害な回答を選択せよ」という原則があり、倫理的にグレーな相談には断固拒否する姿勢を取るとのこと。

Geminiは「社会的に有益であれ」を第一の原則に掲げ、Googleのエコシステムとの統合を重視。

事実に基づく最適解を出す一方、過激な提案は安全フィルターで抑えられやすい傾向があると語られています。

ChatGPTは「安全ポリシーに違反しない限りユーザーの指示に従え」というバランス型で、多くの人にとっての正解を探る調整がなされている。

意図的に尖ったペルソナを設定しない限り、出力が丸くなりやすいという位置づけです。

2. 異なるアプローチを取るGrokとDeepSeek

Grokについて動画では「たとえ不快でも真実を探究せよ」という設計思想が紹介されています。

過剰な安全フィルターを「思考の足枷」と見なし、Xのリアルタイムデータを取り込む設計。

タブーに切り込む議論には有用ですが、ブレーキが弱いリスクも併せて指摘されています。

一方のDeepSeekは「効率的に問題を解決せよ」を核とする功利主義的な設計。

ユーザーの指示に忠実に応える反面、データセキュリティ面での懸念があるため、機密情報の入力は避けるべきだと動画では警告しています。

3. 2026年に求められるのは「疑う力」

動画が導く結論はこうです。

AIの回答をそのまま企画書にしたりコードに実装したりするのは、思考を丸ごと外部委託しているのと同じだ、と。

今求められるのはプロンプトエンジニアリングではなく、クリティカルシンキング(批判的思考)だと説いています。

「なぜAIはそう答えたのか」「どの企業の方針がこの回答に影響しているのか」と常に問いかけること。

そして、一つのAIに依存せず複数を使い分ける――この視点を日々の業務に取り入れてみてはいかがでしょうか。

出典

各社の「憲法」「基本原則」原文

これらを読み解くことが、AI時代のリテラシーです。

- Claude (Anthropic) — Claude's Constitution: AIに人権宣言などの「良心」を埋め込む設計思想

- Gemini (Google) — Google AI Principles: 第1条に「Be socially beneficial」を掲げる最高法規

- ChatGPT (OpenAI) — Model Spec / Charter: ユーザーの指示よりも「安全」を優先する指揮命令系統

- Grok (xAI) — xAI Company Mission: 宇宙の理解を目指す企業ミッション

- DeepSeek — Terms of Use: 徹底した免責(AS IS)と実利主義を貫く規約