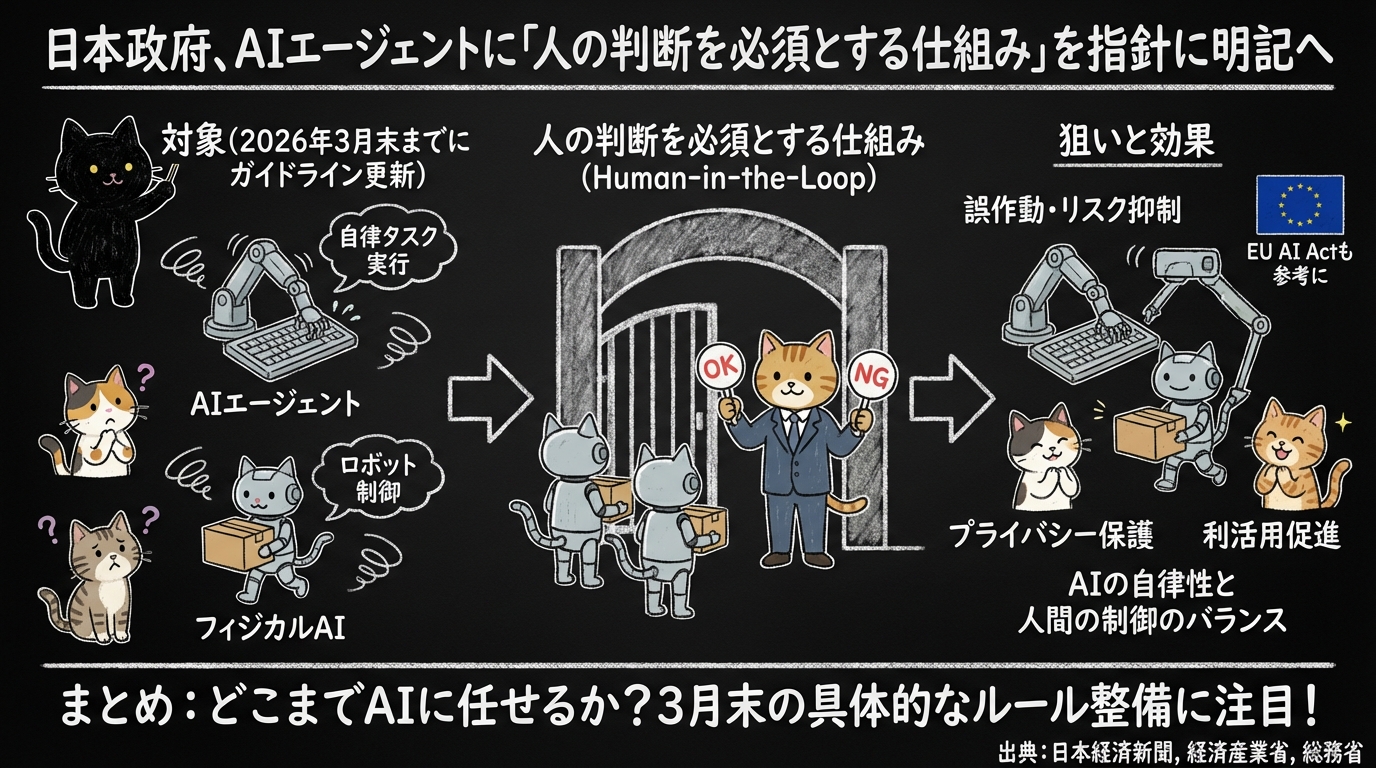

日本政府、AIエージェントに「人の判断を必須とする仕組み」を指針に明記へ

日本経済新聞(2026年2月13日報道)によると、総務省と経済産業省が「AI事業者ガイドライン」を更新し、2026年3月末にもまとめる方針を固めました。

対象は、自律的にタスクを実行する「AIエージェント」と、ロボットを制御する「フィジカルAI」。

開発企業に対して、人間の判断を組み込む仕組みの構築を求める内容です。

概要

報道によれば、AIエージェントやフィジカルAIを開発する企業に、人間の判断を必須とする仕組み(Human-in-the-Loop)の実装を求める方針。

誤作動やプライバシー侵害のリスクを抑えつつ、AIの利活用を促す狙いがあるとされています。

詳細

1. ガイドラインの対象 ― 「AIエージェント」と「フィジカルAI」

今回のガイドラインが対象とするのは2つの領域。

AIエージェントは、システム操作やタスク実行を自律的に行うAI。

フィジカルAIは、ロボットを制御して物理世界で動作するAI。

いずれも人間の監視なしに動作する場面が増えているため、規制の対象として明記される方針です。

2. 「どこまでAIに任せるか」の線引き

ガイドラインのポイントは、AIの自律性と人間の制御のバランス。

「人間が最終判断を下す仕組み(Human-in-the-Loop)」の実装を開発企業に求めることで、AIの暴走リスクを制度的に抑える狙い。

EUのAI Act(EU人工知能法)でも高リスクAIに人間の監視を求めており、方向性として通じるものがあると考えられます。

3. 3月末の策定に向けて

同報道では、ガイドラインは2026年3月末の策定を目指しているとのこと。

具体的にどのレベルの「人間の判断」が求められるのかなど、詳細はまだ明らかになっていません。

AIエージェントの普及が急速に進む中、国としてのルール整備がどこまで具体化するかが注目されます。

まとめ

AIエージェントが急速に普及する中で、「どこまでAIに任せて、どこで人間が判断するか」の線引きが国レベルで議論されています。

3月末のガイドライン策定に向けた今後の動きに注目です。